Google lanza una competición para mejorar el algoritmo JPEG de compresión de imágenes

Google atribuye gran parte de la culpa de las esperas mientras se carga una página web a las imágenes comprimidas con algoritmos obsoletos. La forma más común de esa compresión es el conocido códec JPEG, que ha existido desde mediados de los 80’s.

📱💻 ¡Chollazos! ¡Hemos seleccionado las mejores ofertas tecnológicas para que tú no pierdas tiempo! [ Saber más ]

En 2010 Google anunció el desarrollo del formato de compresión WebP, que podía hacer el mismo trabajo que JPEG con aproximadamente un tamaño que es un 30% inferior, pero la empresa todavía no está satisfecha.

Los investigadores de Google se han dado cuenta de que todavía hay mejores maneras de comprimir una imagen a un tamaño mucho más pequeño y luego descomprimirla sin que pierda su calidad visual original. Y siendo Google, el mejor camino hacia una mayor compresión se basa en la inteligencia artificial.

«Las imágenes siguen siendo demasiado grandes y lentas para cargarlas en los teléfonos, así que estamos organizando una competición para ver cuánto más pequeñas y rápidas puedes hacerlas», dijo Sundar Pichai, director ejecutivo de Google, a través de un tweet.

La competición a la que Pichai se refiere es el Workshop and Challenge on Learned Image Compression, que Google patrocina en colaboración con el laboratorio de visión artificial ETH Zurich y Twitter. El desafío será parte de la conferencia «Visión por Computadora y Reconocimiento de Patrones» (CVPR, por sus siglas en inglés), que se llevará a cabo del 18 al 21 de junio en Salt Lake City, donde se planea reunir a expertos en métodos «tradicionales» de compresión, así como a aquellos que están abriendo nuevos caminos con el uso de la compresión basada en el aprendizaje.

Como nos recuerda el científico investigador de Google Michele Covelle en el blog de la empresa, sin compresión, la foto de 12 megapíxeles que haces con tu smartphone ocuparía 32MB de almacenamiento. Pero el problema es que al comprimir un archivo multimedia casi siempre se pierde algo del original. Por lo tanto, una buena compresión no sólo consiste en hacer que las imágenes sean más pequeñas, sino en elegir qué aspectos de la imagen pueden ser ignorados en el proceso, y luego cómo reinterpretar mejor la información que queda para que se parezca más a la original.

Esto puede ser un proceso altamente subjetivo, haciendo de la compresión una especie de forma artística. Los seres humanos son los que tienen que decidir qué información en una imagen tiene más sentido para que un formato de compresión conserve, modifique y descarte, pero esas decisiones se basan en las características del ojo humano.

Por ejemplo, los seres humanos perciben el brillo más fácilmente que el color, y son más sensibles a algunos colores que a otros. Si un ser humano es incapaz de percibir algún matiz de una imagen, o la perciben mal, ¿por qué molestarse en perder un valioso espacio de almacenamiento y ancho de banda en él?

Cuando se piensa de esa manera, la idea de que la inteligencia artificial es el mejor medio para mejorar este proceso comienza a tener sentido.

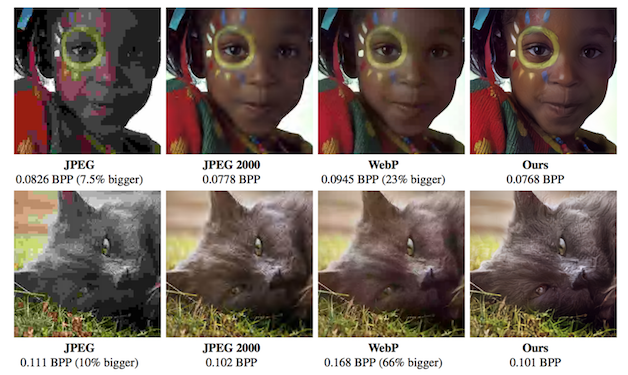

Aquí es donde entran en juego las redes neuronales. Google ha hecho algunos avances significativos en la compresión basada en el aprendizaje en los últimos años. En 2016 mostró cómo dos grupos de redes neuronales pueden producir imágenes comprimidas de mayor calidad con un 25% menos de tamaño de archivo.

Esto se logró haciendo que una red neuronal ejecutara una compresión y descompresión inicial de una imagen, y comparando la nueva imagen con la original. Luego se obtiene el «residual», los errores, donde la segunda imagen difiere del original. Ese residuo se devuelve a la red neuronal. Así es, los errores se convierten en la entrada, de la que se deriva una imagen de mayor calidad.

Google cree que sólo ha arañado la superficie de lo que la compresión basada en el aprendizaje de máquinas puede lograr. «Este rápido avance en la calidad de los sistemas de compresión basados en redes neuronales y en el trabajo de un número relativamente pequeño de laboratorios de investigación, nos lleva a esperar resultados aún más impresionantes cuando el área es explorada por una mayor parte de la comunidad de aprendizaje de máquinas», escribe Covell.

Ciertamente, Google tiene mucho interés en ir más allá. Cuanto más rápido se carguen tus imágenes y mejor se vean cuando aparezcan, más agradable será tu experiencia en Internet. Cuanto más usas Internet, más interactuas con Google. Pero eso no es todo lo que busca la compañía.

«Si podemos mejorar la compresión de imágenes, la forma en que usamos las imágenes podría cambiar radicalmente», dijo Covell a Android Police. «Podríamos permitir mejores (y menos costosos) diagnósticos médicos: simplemente enviando un montón de imágenes de los problemas de los pacientes a los mejores médicos sin mucho retardo ni gastos generales, especialmente para los pacientes en áreas que están mal atendidas (zonas rurales, por ejemplo).».

Los sistemas de compresión basados en el aprendizaje pueden personalizarse para adaptarse a necesidades particulares, favoreciendo la información relevante dentro de una imagen sobre algo menos útil que la estética, como en los diagnósticos médicos.

“Por ejemplo, en las mamografías, si la diferencia en la densidad tisular y los límites entre los tejidos densos y no densos son importantes para el diagnóstico, podríamos incluir eso en la medida de nuestra métrica de calidad, para ser capaces de crear archivos de rayos X lo suficientemente pequeños para todos para estudios a largo plazo«, dijo Covell, y agregó: “Podríamos proporcionar más información en emergencias: podríamos enviar fotos de situaciones en zonas de desastre, incluso cuando el ancho de banda disponible es limitado.»

Es fácil entender por qué Twitter está también interesado en esto. Los tamaños de archivo más pequeños significan una carga más ligera en la infraestructura de Twitter, e imágenes de mayor calidad deberían, en teoría, dar a los usuarios una mejor experiencia.

Para el Desafío sobre la compresión de imágenes, Google pondrá a disposición de los usuarios una base de datos de imágenes de alta resolución.