Google comienza a utilizar RAISR en Google+ para comprimir fotografías hasta un 75 por ciento sin pérdida de calidad

Google presentó en noviembre una innovadora tecnología de compresión de imagen llamada RAISR (Rapid and Accurate Super Image Resolution), que ha sido diseñada para ahorrar los preciados datos móviles sin sacrificar la calidad de imagen.

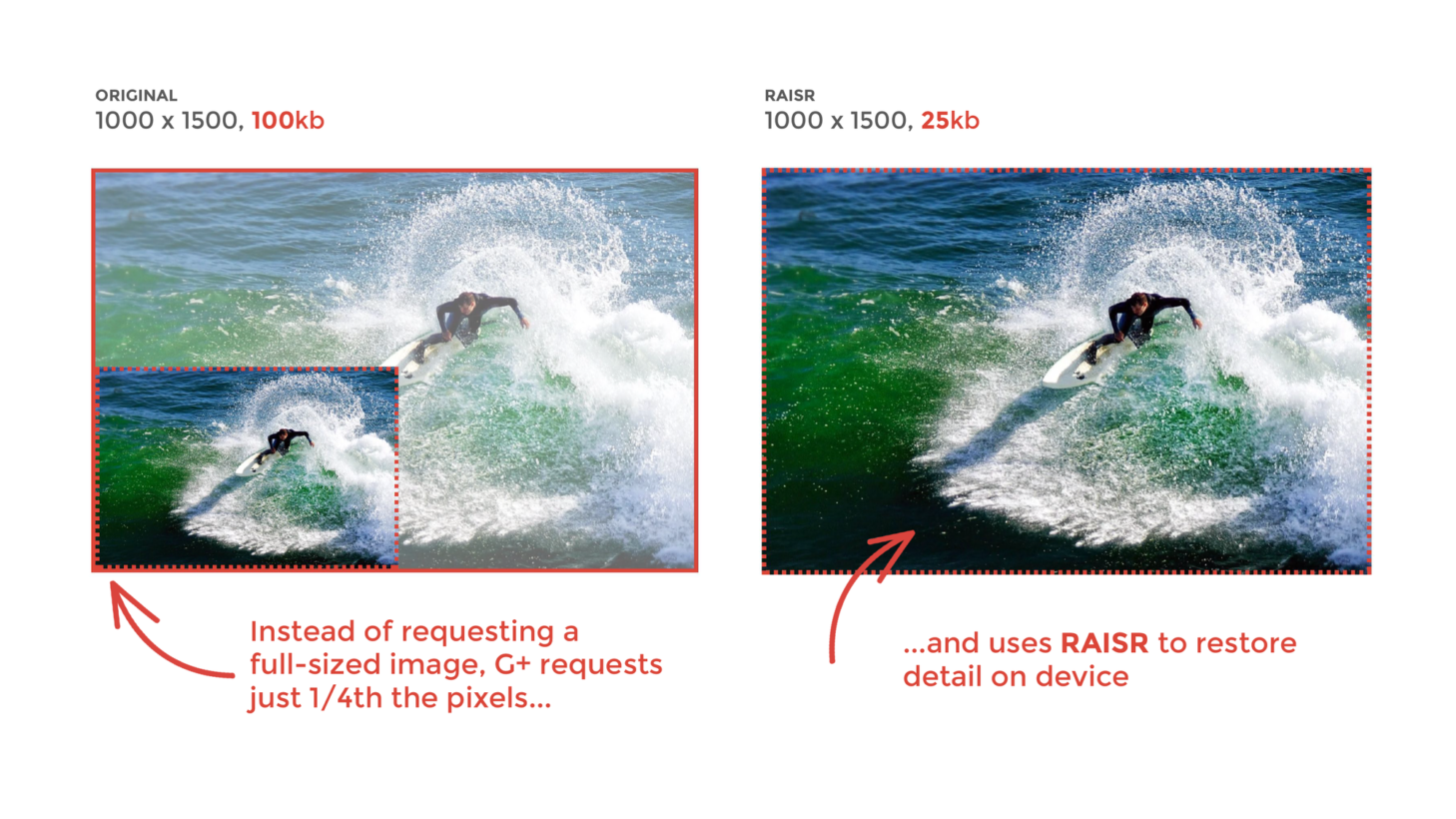

RAISR requiere hasta un 75 por ciento menos ancho de banda, ya que analiza las versiones de baja y alta resolución de una misma imagen, aprende qué hace que la versión más grande posea una calidad superior y simula las diferencias en la versión más pequeña.

En esencia, el sistema consigue engañar a tu ojo para que crea que la versión de menor calidad de la imagen está a la altura de la versión de tamaño completo.

Ahora Google ha anunciado que ha comenzado a utilizar esta tecnología en Google+, donde más de 1.000 millones de imágenes son servidas con este sistema cada semana, reduciendo el consumo de datos del usuario.

Se trata del segundo uso práctico de esta tecnología, ya que en diciembre Google anunció que estaba empleando RAISR para mejorar la nitidez de los vídeos exportados desde su app para iOS, Motion Stills, al capturar fotografías con la funcionalidad Live Photo de iOS.

Por otro lado, Google ha anunciado su intención de ampliar el uso de RAISR a más aplicaciones en los próximos meses.